La IA No se Frena, se Optimiza: 3 Cambios Prácticos si el Cómputo se Vuelve Más Caro

Cada cierto tiempo aparece una noticia que parece hablar de política, infraestructura o regulación… pero que en realidad anticipa algo mucho más cercano: el costo real de trabajar con IA.

Si construir, correr o escalar sistemas de IA se vuelve más caro por energía, cómputo o restricciones de infraestructura, la pregunta ya no es teórica.

La pregunta es:

¿qué debería cambiar hoy en la forma en que construyes con IA para no volverte dependiente de un stack ineficiente?

La buena noticia es que esto no se resuelve con más humo. Se resuelve con mejores decisiones.

Aquí van 3 cambios prácticos que hoy ya puedes aplicar.

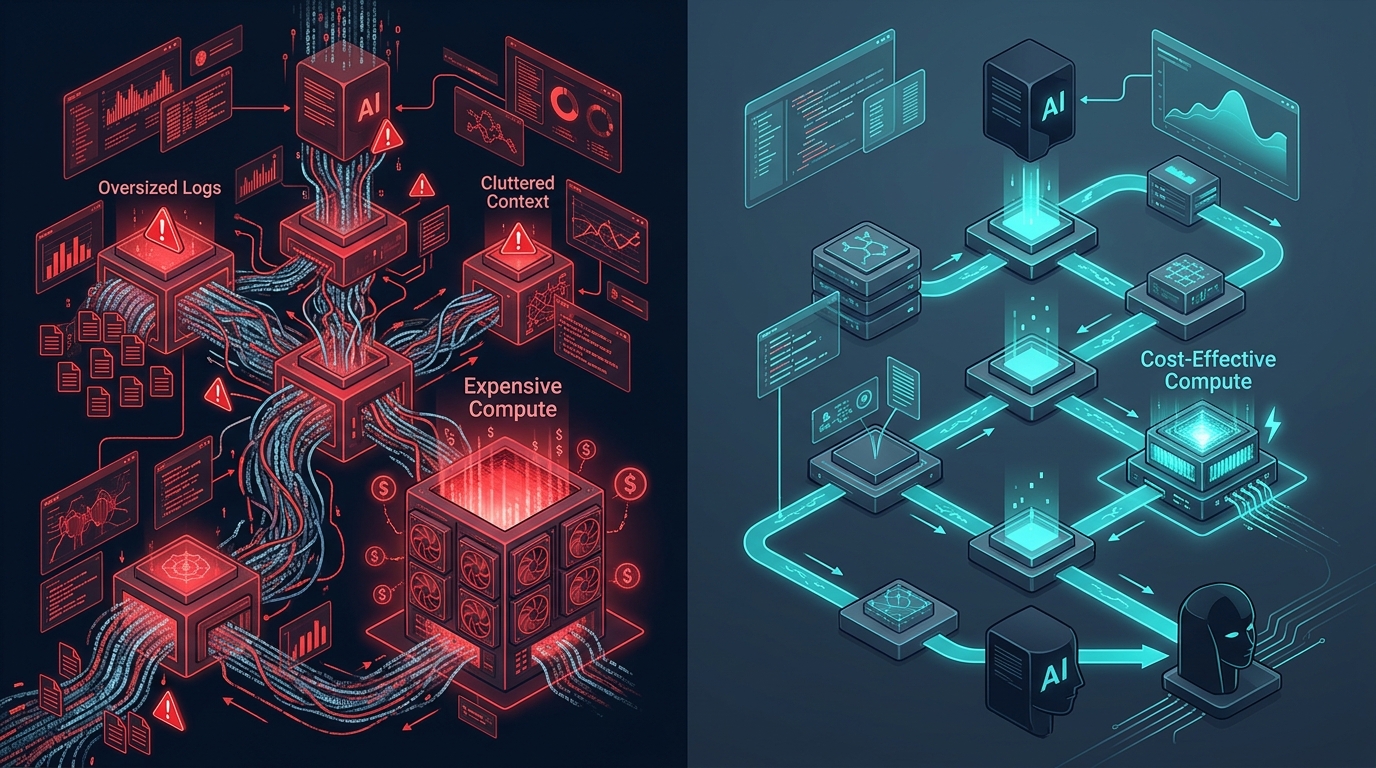

1. Deja de mandar ruido al modelo

Uno de los errores más comunes en equipos que trabajan con IA es pensar que “más contexto” siempre ayuda.

No siempre.

Muchas veces lo que realmente estás mandando es:

- logs innecesarios

- diffs gigantes

- archivos completos cuando bastaban fragmentos

- resultados de búsqueda repetidos

- instrucciones desordenadas

Eso no solo aumenta costo. También empeora calidad.

Qué hacer

Empieza a pensar en higiene de contexto.

Eso significa:

- resumir antes de enviar

- fragmentar mejor archivos largos

- usar salidas compactas de git y shell

- evitar duplicación entre prompt, historial y tool output

- guardar memoria útil para no volver a explicar lo mismo

Regla simple

Si una línea no ayuda al modelo a decidir mejor, probablemente no debería estar en el contexto.

Este solo cambio mejora costo, foco y velocidad.

2. No uses el modelo más caro para todo

Muchos flujos de IA están mal diseñados porque usan un modelo potente para tareas que no lo necesitan.

Por ejemplo:

- clasificación simple

- extracción estructurada

- reformateo

- validaciones pequeñas

- resúmenes operativos

No todo necesita “modo dios”.

Qué hacer

Separa tareas por nivel de complejidad:

- modelo barato / rápido para clasificación, parsing, transforms y routing

- modelo fuerte solo para razonamiento difícil, escritura compleja o decisiones ambiguas

Ejemplo práctico

En vez de mandar todo a un modelo premium:

- un modelo pequeño filtra y estructura

- solo los casos difíciles escalan al modelo caro

Eso baja muchísimo el costo total sin perder calidad donde importa.

3. Diseña workflows, no prompts sueltos

Otro error clásico: resolver todo con prompts manuales cada vez.

Eso funciona para experimentar, pero no para operar bien.

Si el cómputo se vuelve más caro, los workflows improvisados se vuelven todavía más ineficientes.

Qué hacer

Convierte tareas repetidas en sistemas más ordenados:

- inputs claros

- pasos separados

- memoria útil

- herramientas definidas

- outputs esperados

- validación humana donde haga falta

Cuando haces eso, pasan dos cosas:

- el sistema gasta menos contexto porque no reexplica todo desde cero

- la calidad sube porque el flujo deja de depender del azar del prompt del día

Pregunta útil

Antes de automatizar algo con IA, pregúntate:

¿Esto debería ser una conversación, o debería ser un workflow?

Esa diferencia cambia muchísimo el costo y la confiabilidad.

El punto de fondo

Si el cómputo para IA se encarece, los equipos que mejor van a responder no son los que más hablan de IA.

Son los que ya aprendieron a:

- cuidar contexto

- elegir bien modelos

- estructurar workflows

- y convertir herramientas en ventaja operativa

Además, hay una confusión bastante común que conviene corregir: mucha gente cree que si usar un chatbot premium “se siente barato”, entonces producir con IA también debería ser barato.

No necesariamente.

En la práctica, gran parte del mercado está viviendo una especie de subsidio implícito en la capa de chat/consumo, mientras que la verdadera monetización fuerte ocurre en API, producción y uso intensivo.

Eso explica por qué a veces una experiencia conversacional parece accesible, pero cuando intentas escalar flujos reales con API, automatización o agentes, los costos cambian drásticamente.

No es una contradicción. Es el modelo de negocio.

Por eso optimizar tokens, contexto y arquitectura no es obsesión técnica. Es una forma de proteger margen cuando pasas de jugar con IA a operar con IA.

En otras palabras:

la próxima ventaja no va a venir solo de tener acceso a modelos. Va a venir de saber usarlos con disciplina.

Mi recomendación

Si hoy trabajas con IA en desarrollo, contenido, operaciones o automatización, revisa estas tres cosas esta misma semana:

- qué ruido le estás mandando al modelo

- qué tareas podrías mover a modelos más baratos

- qué procesos sigues resolviendo con prompts sueltos en vez de workflows

No necesitas esperar una crisis de infraestructura para optimizar.

Los equipos que empiezan antes son los que después pueden escalar mejor.

Escrito por Leonardo Castillo

Arquitecto de Agentes IA y Co-Fundador de Milytics. Escribo sobre automatización extrema, Web 4.0 y cómo los sistemas autónomos están reemplazando las operaciones estáticas.

Artículos Relacionados

5 Errores que Hacen que tu Stack de IA te Salga Mucho Más Caro de lo Necesario

Muchos equipos creen que el problema de costo en IA está en el modelo. En realidad, suele estar en mala arquitectura, ruido, prompts repetidos y workflows mal diseñados.

Agentes IA Contextuales: Cómo el 'Contexto Humano' Redefine la Automatización de la Web 4.0

Nyne revoluciona IA. Analizamos cómo el contexto humano transformará agentes, empresas y el desarrollo de software, marcando el fin del software estático y el inicio de la Web 4.0.

Agentes IA en el Corazón del Sistema: ¿systemd 260 Marca el Inicio de la Infraestructura para la Web 4.0?

Descubre cómo systemd 260 y la integración de Agentes IA marcan el fin del software estático y el inicio de la infraestructura autónoma para la Web 4.0. El futuro es cognitivo.