Por Qué el 73% de los Proyectos de IA Fracasan (Y Cómo Evitarlo)

He visto morir más proyectos de IA que los que he visto llegar a producción. Y no hablo de startups con founders delirantes. Hablo de empresas Fortune 500 con presupuestos de 7 cifras que terminan con un prototipo en Google Colab que nadie usa.

Según Gartner (2025), el 73% de los proyectos empresariales de IA nunca llegan a generar valor comercial. Después de liderar 20+ implementaciones, puedo decirte exactamente por qué fracasan y cómo evitar convertirte en otra estadística.

Error Fatal #1: “Vamos a Implementar IA en Todo”

El Síntoma

CEO en reunión trimestral: “Nuestros competidores están usando IA. Necesitamos una estrategia de IA YA.”

CTO aterrorizado crea un “Comité de IA” que pasa 6 meses debatiendo frameworks filosóficos mientras contratan 3 PhDs en Machine Learning que no entienden el negocio.

Por Qué Fracasa

La IA no es una estrategia, es una herramienta. Es como si dijeras “nuestra estrategia es usar Excel” o “nuestra estrategia es tener reuniones”.

El error: buscar problemas para tu solución, en lugar de soluciones para tus problemas.

El Antídoto: El Framework de la Pregunta Inversa

No preguntes: “¿Dónde podemos usar IA?” Pregunta: “¿Cuáles son los 3 procesos que están destruyendo nuestra productividad?”

Ejemplo real de una empresa de logística:

❌ Enfoque fallido: “Implementemos Computer Vision en nuestros almacenes” ✅ Enfoque ganador: “El 40% de nuestros envíos se retrasan por errores manuales en etiquetado. ¿Cómo lo resolvemos?”

La IA apareció como solución natural, no como mandato ejecutivo.

Checklist de Validación Antes de Empezar

- ¿Puedes cuantificar el problema en dinero o tiempo perdido?

- ¿Actualmente tienes al menos 1 persona fulltime dedicada a este proceso?

- ¿El proceso se ejecuta al menos 50 veces al mes?

- ¿La tasa de error actual es >10%?

Si respondiste “No” a más de 2 preguntas, no es un caso de uso válido.

Error Fatal #2: Contratar Data Scientists Antes de Limpiar los Datos

El Síntoma

“Contratamos un equipo de ML Engineers élite, pero después de 4 meses no tienen nada en producción porque ‘los datos no están listos’.”

Por Qué Fracasa

El 80% del trabajo en proyectos de IA no es IA, es ingeniería de datos:

- ETL (Extract, Transform, Load) desde sistemas legacy

- Limpieza de duplicados y valores nulos

- Normalización de formatos (fechas, monedas, nombres)

- Migración de Excel/CSV a bases de datos relacionales

- Creación de APIs para conectar sistemas desconectados

Si tu data warehouse es un caos, contratar un PhD en Deep Learning es como contratar un chef Michelin para cocinar en una cocina sin estufa.

El Antídoto: La Regla del 80/20 Inverso

Antes de tocar modelos de IA:

-

Auditoría de Fuentes de Datos (Semana 1-2)

- Mapea TODAS las fuentes: CRMs, ERPs, Sheets, emails, PDFs escaneados

- Identifica qué datos son críticos vs “sería bueno tener”

- Documenta formato, frecuencia de actualización, calidad actual

-

Pipeline de Limpieza (Semana 3-6)

- Centraliza en un data warehouse (PostgreSQL, Supabase, Snowflake)

- Crea scripts de validación automática

- Establece data quality checks (Alertas cuando % de nulos supera threshold)

-

SOLO DESPUÉS: Contrata al equipo de IA

Señal de Alerta Roja 🚨

Si tu equipo de IA dice “necesitamos 6 meses más para preparar los datos” es porque:

- No definiste el alcance del problema (error #1)

- No tienes un Data Engineer antes de un ML Engineer

Solución práctica: Contrata 1 Data Engineer por cada 3 ML Engineers. Los Data Engineers son los fontaneros del proyecto; los ML Engineers son los arquitectos. No puedes construir sin fontanería.

Error Fatal #3: Obsesionarse con el Modelo “Perfecto”

El Síntoma

“Nuestro modelo tiene 94% de accuracy. Necesitamos llegar a 98% antes de producción.”

Mientras tanto, el negocio sigue perdiendo $50,000/mes por el problema que el modelo del 94% ya resolvería.

Por Qué Fracasa

Perfectionism paralysis. Los ingenieros de ML vienen del mundo académico donde el objetivo es publicar papers con benchmarks. En empresas, el objetivo es generar valor comercial.

El Antídoto: La Métrica del “Good Enough”

No necesitas un modelo perfecto. Necesitas un modelo mejor que el proceso actual.

| Escenario | Accuracy Humano | Accuracy IA Requerido |

|---|---|---|

| Clasificación de tickets de soporte | 85% | >88% |

| Detección de fraude en transacciones | 78% | >82% |

| Cotizaciones automáticas | 91% | >93% |

| Moderación de contenido | 72% | >75% |

Si tu modelo supera al humano por +3-5%, lánzalo a producción con human-in-the-loop.

El Framework de Lanzamiento Progresivo

Fase 1 (Mes 1): Modelo en modo “shadow” (procesa todo pero no actúa)

- Compara decisiones IA vs humano

- Identifica edge cases

Fase 2 (Mes 2): Modo “copilot” (sugiere, humano decide)

- IA propone acción, humano aprueba/rechaza

- Track acceptance rate

Fase 3 (Mes 3): Modo “autopilot” (IA decide, humano supervisa)

- IA actúa automáticamente en casos con confianza >90%

- Escala a humano en casos ambiguos

Nunca lances directo a Fase 3. Es un suicidio reputacional.

Error Fatal #4: No Diseñar para el “Día 367”

El Síntoma

Modelo funciona perfecto en producción por 8 meses. De repente, el accuracy cae de 92% a 64% sin razón aparente.

Razón: Model drift. El mundo cambió, tu modelo no.

Por Qué Fracasa

Los modelos de ML no son “instalar y olvidar”. Son organismos vivos que necesitan:

- Reentrenamiento periódico (con datos nuevos)

- Monitoreo de performance (detectar drift antes que sea crítico)

- Versionado de modelos (rollback cuando la nueva versión empeora)

El 68% de las empresas no tienen MLOps establecido. Lanzan modelos como si fueran features de frontend.

El Antídoto: El Stack Mínimo de MLOps

Antes de producción, establece:

-

Observability:

- Logs de todas las predicciones (input, output, confidence score)

- Dashboard con métricas en tiempo real (Grafana, Datadog)

- Alertas automáticas si accuracy < threshold

-

Retraining Pipeline:

- Script automatizado para reentrenar con datos nuevos

- A/B testing: modelo viejo vs modelo nuevo en tráfico real

- Rollback automático si nuevo modelo underperforms

-

Data Versioning:

- DVC (Data Version Control) o herramienta similar

- Cada modelo debe saber con qué versión de datos fue entrenado

-

Human Feedback Loop:

- Botón “Esta predicción fue incorrecta” en la UI

- Feedback alimenta automáticamente dataset de reentrenamiento

Regla de oro: Si no puedes hacer rollback de tu modelo en <5 minutos, no estás listo para producción.

Error Fatal #5: Ignorar el Cambio Organizacional

El Síntoma

Tu agente IA funciona perfecto técnicamente. Pero nadie en la empresa lo usa porque:

- “No confío en lo que hace”

- “Es más rápido hacerlo manual”

- “No me enseñaron cómo funciona”

Por Qué Fracasa

La tecnología es el 30% del proyecto. El cambio cultural es el 70%.

Si implementas IA sin entrenar al equipo, prepárate para:

- Sabotaje pasivo (usuarios evitan usar el sistema)

- Errores magnificados (usuarios no saben detectar cuándo la IA se equivoca)

- Rotación de personal (miedo a ser reemplazados)

El Antídoto: El Protocolo de Adopción

Semana -4 (Antes de Lanzamiento):

- Sesión de “AMA” (Ask Me Anything) con equipo completo

- Demos en vivo del sistema

- Abordar miedos: “¿Me van a despedir?” (Respuesta honesta: roles cambian, no desaparecen)

Semana 0 (Lanzamiento):

- Co-pilot mode obligatorio (IA sugiere, humano decide)

- Champion program: identifica early adopters y dales ownership

Mes 1-3:

- Office hours semanales para resolver dudas

- Dashboard público con métricas de impacto (horas ahorradas, errores reducidos)

- Incentivos para equipos con mayor adopción

Señal de Éxito: Cuando los usuarios empiezan a reportar bugs en la IA porque quieren que funcione mejor, ganaste.

El Framework del Proyecto Anti-Frágil

Resumen ejecutivo para evitar los 5 errores:

1. [Problema Comercial Claro] → No "IA por IA"

↓

2. [Data Engineering Primero] → No PhDs sin datos limpios

↓

3. [MVP con 85% Accuracy] → No perfeccionismo paralizante

↓

4. [MLOps desde Día 1] → No "lanzar y rezar"

↓

5. [Change Management] → No tecnología sin adopciónSi saltas cualquier paso, multiplicas por 10 tu probabilidad de fracaso.

La Pregunta Final

Si tu proyecto de IA actual no puede responder estas 3 preguntas en 60 segundos, estás en problemas:

- ¿Cuánto dinero/tiempo estamos perdiendo AHORA por no tener esto?

- ¿Cómo sabemos si está funcionando después de lanzar?

- ¿Quién es responsable de mantener esto en 12 meses?

El 73% de proyectos fracasa porque nadie hace estas preguntas hasta que es demasiado tarde.

No seas otra estadística. Pregunta ahora.

Escrito por Leonardo Castillo

Arquitecto de Agentes IA y Co-Fundador de Milytics. Escribo sobre automatización extrema, Web 4.0 y cómo los sistemas autónomos están reemplazando las operaciones estáticas.

Artículos Relacionados

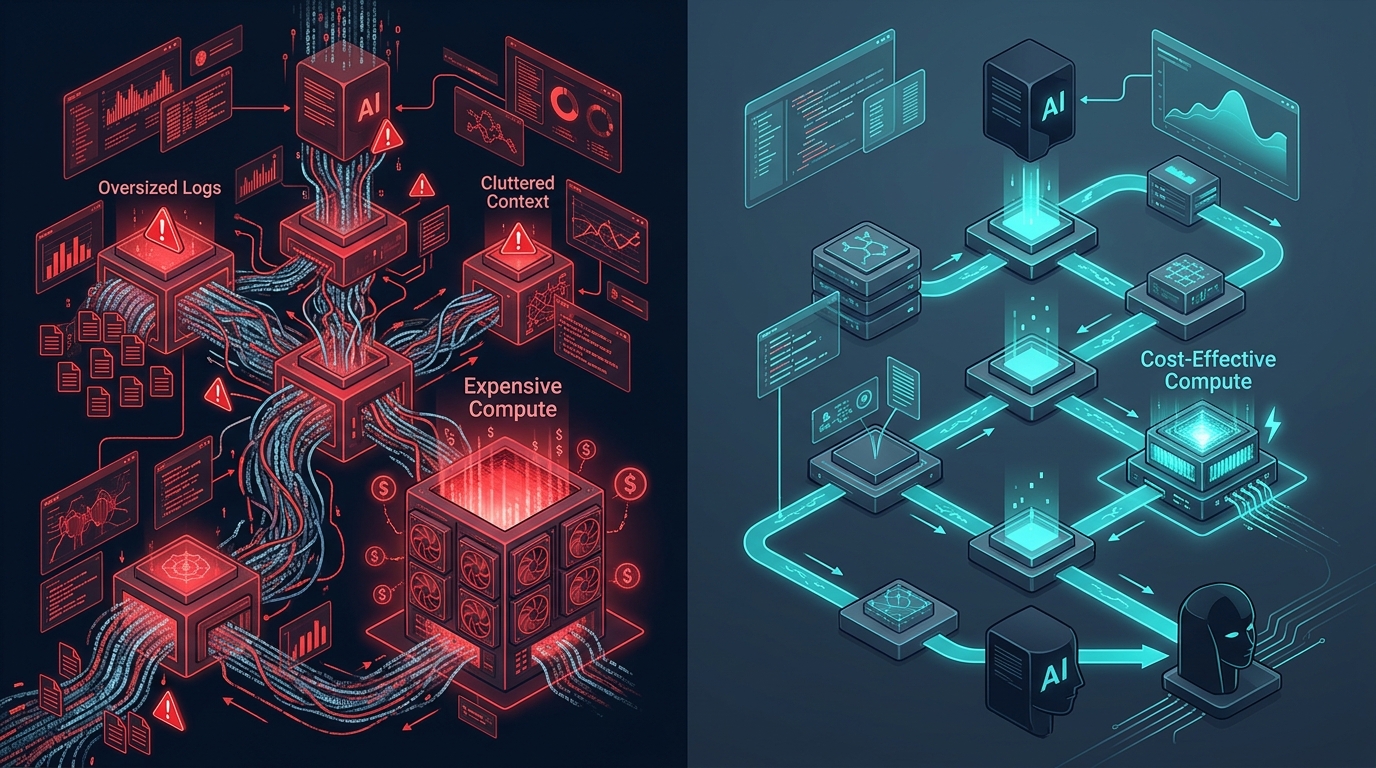

5 Errores que Hacen que tu Stack de IA te Salga Mucho Más Caro de lo Necesario

Muchos equipos creen que el problema de costo en IA está en el modelo. En realidad, suele estar en mala arquitectura, ruido, prompts repetidos y workflows mal diseñados.

Agentes IA Contextuales: Cómo el 'Contexto Humano' Redefine la Automatización de la Web 4.0

Nyne revoluciona IA. Analizamos cómo el contexto humano transformará agentes, empresas y el desarrollo de software, marcando el fin del software estático y el inicio de la Web 4.0.

Agentes IA en el Corazón del Sistema: ¿systemd 260 Marca el Inicio de la Infraestructura para la Web 4.0?

Descubre cómo systemd 260 y la integración de Agentes IA marcan el fin del software estático y el inicio de la infraestructura autónoma para la Web 4.0. El futuro es cognitivo.